做网站优化我们要规避哪些蜘蛛陷阱?

浏览次数:50 分类:SEO优化

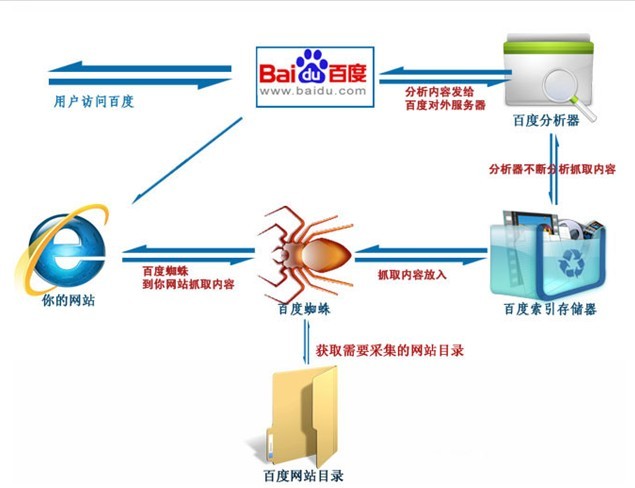

做网站优化seo技术蜘蛛屯网站优化,重点往往不是”我们觉得”而是“搜索引擎觉得”,所以除了要产出大量优质内容外,还要清除不利于搜索引擎理解我们网站的障碍,比如蜘蛛陷阱:flash、图片、js调用、session ID.各种跳转、frame框架、必须登录、导航栏js、必须使用cookies等。下面就由我们一起看一下具体情况和解决方案。

蜘蛛陷阱介绍

1、JS脚本

JS在网站建设中有着举足轻重的作用,因为它能为网站实现很多酷炫的效果,但是依旧摆脱不了不利于蜘蛛爬取的问题,而且网站有太多的JS还会影响严重影响网站的加载速度。

解决办法:对于某些排名毫无意义的页面,用JS脚本阻止蜘蛛对它的抓取,由于集中权重

2、Flash模块

Flash模块确实给人的视觉效果非常棒的体验,但蜘蛛难以识别flash内容,所以过多的flash会影响,搜索引擎对网站相关性的判断。

解决办法:视频网站用FLASH格式可以达到占用资源小 效益最大化的目的。

3、frame框架结构

落后就要挨打,在现在的智能时代,框架结构逐渐落伍并且非常不利于蜘蛛爬取网站的内容。

解决办法:用DIV+css或者Ajax代替frame吧

4、Session ID

网站采用Session ID做用户跟踪访问,会导致蜘蛛访问这种网站的时候,即使访问的是同一个页面,也会出现不一样的ID,根本就很难判断出哪个url才是主要页面,甚至还会误判为网站有大量页面存在重复的内容,导致网站降权。

解决办法:技术处理,把session id保存在persistent cookie中(通过设置session的最大有效时间),然后在新窗口读出上一个窗口的session id。

5、带各种参数的动态URL

网站动态的URL越多,网站越会误导搜索引擎,如果设置不当也会造成搜索引擎判断不清到底哪个是正规的页面(原理上跟SessionID相似),而且动态URL也是不利于蜘蛛抓取的,我们应该避免,建议站长手上的网站都要做一下静态化,并且屏蔽掉那些异常参数的url。

解决办法:做好网站URL规范化处理,避免动态参数过多。

6、登录限制或强制使用cookie

有登录限制的内容,对于搜索引擎来说它即不会注册也不会登录,这样的内容蜘蛛是发现不了的;同样强制使用Cookies只能造成搜索引擎蜘蛛无法正常访问。

建议:详情页

7、异常跳转

杂七杂八的跳转,常用于一般灰帽或黑帽,做采用变相引流。常见的例如:JS跳转、Flash跳转、302跳转等。而至于301跳转是受搜索引擎推荐和认可的,所以不包括在列。

解决办法:白帽seo尽量少用,否则会被当做作弊手段。

最后,有些网站为了跟用户交流就时不时的强出很多聊天窗口,这些往往会降低用户体验,而且这些聊天窗口搜索引擎也无法识别的,所以尽量不用。

在对网站优化的过程中如何避免蜘蛛陷阱呢?

如今我们在对网站进行优化的时候想要获得比较好的排名,首先就需要和搜索引擎蜘蛛打好关系是非常重要的,这时候会有很多的新起的SEO优化人员往往会忽略,甚至会给搜索引擎挖坑。那么我们该怎样去避免这一些问题呢?

一、首页上尽最大可能不去采用Flash结构

为什么说首页不要区采用Flash机构呢?因为搜索引擎蜘蛛对此类页面的抓取,是不太容易抓取的,这样的话你网站首页会在搜索引擎蜘蛛中留下的印象会非常不佳。

二、避免网站中的URL动态参数

网站中尽量少才有URL动态页面,这种页面的住区难度要比静态页面的抓取难度高的多,静态页面更加容易搜索引擎的抓取及用户的记忆。

三、网站中页面跳转

如今网站优化中页面跳转的方式一般为:301/302跳转这样的跳转会给蜘蛛带来非常大的反感。也不利于搜索引擎蜘蛛的抓取。建议大家尽量不要去采用。

四、网页层级不要太深

层级太深,蜘蛛抓取很困难,一般网站首页权重最高,内容到首页的距离太远seo技术蜘蛛屯网站优化,被分到的权重就会减少。如果内容不是太多,尽量采用一个层级,这样缩短内容到达首页的距离,越容易得到首页权重传递。

五、网站网页中层级不要太深

网页的层级建议大家做多设置成3级,这样容易蜘蛛的抓取,如果说你网页设置成为6级这样蜘蛛第一次会抓取6级页面、第二次也会,但是第三次第四次绝对不会。

深圳南山seo

深圳南山seo

售前咨询

售前咨询

您好!请登录